算法干货 | 朴素贝叶斯分类

分类算法是机器学习算法中的一种,用来判断给定数据项所属的类别,即种类或类型。比如,可以根据某些特征来分辨一部电影属于哪个流派,等等。这样,流派就是我们要预测的类别。第10章“预测性分析与机器学习”还会对机器学习做进一步介绍。此刻,我们要讨论的是一个名为 朴素贝叶斯分类 的流行算法,它常常用于进行文本文档的研究。

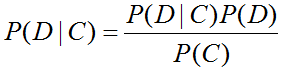

朴素贝叶斯分类是一个概率算法,它基于概率与数理统计中的贝叶斯定理。贝叶斯定理给出了如何利用新证据修正某事件发生的概率的方法。例如,假设一个袋子里装有一些巧克力和其他物品,但是这些我们没法看到。这时,我们可以用 P(D) 表示从袋子中掏出一块深色巧克力的概率。同时,我们用 P(C) 代表掏出一块巧克力的概率。当然,因为全概率是1,所以 P(D) 和 P(C) 的最大取值也只能是1。贝叶斯定理指出,后验概率与先验概率和相似度的乘积成正比,具体公式如下所示:

上面公式中, P(C|D) 是在事件 C 发生的情况下事件 D 发生的可能性。在我们还没有掏出任何物品之前, P(D)= 0.5 ,因为我们尚未获得任何信息。实际应用这个公式时,必须知道 P(C|D) 和 P(C) ,或者能够间接求出这两个概率。

朴素贝叶斯分类之所以称为 朴素 ,是因为它简单假设特征之间是相互独立的。实践中,朴素贝叶斯分类的效果通常都会很好,说明这个假设得到了一定程度的保证。近来,人们发现这个假设之所以有意义,理论上是有依据的。不过,由于机器学习领域发展迅猛,现在已经发明了多种效果更佳的算法。

下面,我们将利用停用词或标点符号对单词进行分类。这里,将字长作为一个特征,因为停用词和标点符号往往都比较短。

为此,需要定义如下所示的函数:

def word_features(word): return {'len': len(word)} def isStopword(word): return word in sw or word in punctuation 下面,对取自古登堡项目的 shakespeare-caesar.txt 中的单词进行标注,以区分是否为停用词,具体代码如下所示:

labeled_words = ([(word.lower(), isStopword(word.lower())) for word in words]) random.seed(42) random.shuffle(labeled_words) print labeled_words[:5]下面显示了5个标注后的单词:

[('was', True), ('greeke', False), ('cause', False), ('but', True), ('house', False)] 对于每个单词,我们可以求出其长度:

featuresets = [(word_features(n), word) for (n, word) in labeled_words]前几章介绍过拟合,以及通过训练数据集和测试数据集的交叉验证来避免这种情况的方法。下面将要训练一个朴素贝叶斯分类器,其中90%的单词用于训练,剩下的10%用于测试。首先,创建训练数据集和测试数据集,并针对数据展开训练,具体代码如下所示:

cutoff = int(.9 * len(featuresets)) train_set, test_set = featuresets[:cutoff], featuresets[cutoff:] classifier = nltk.NaiveBayesClassifier.train(train_set)如今,拿出一些单词,检查该分类器的效果。

classifier = nltk.NaiveBayesClassifier.train(train_set) print "'behold' class", classifier.classify(word_features('behold')) print "'the' class", classifier.classify(word_features('the'))幸运的是,这些单词的分类完全正确:

'behold' class False 'the' class True 然后,根据测试数据集来计算分类器的准确性,具体代码如下所示:

print "Accuracy", nltk.classify.accuracy(classifier, test_set)这个分类器的准确度非常高,几乎达到85%。下面来看哪些特征的贡献最大:

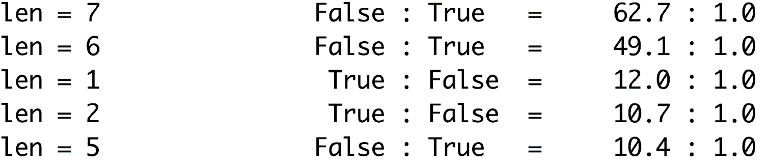

print classifier.show_most_informative_features(5)结果显示,在分类过程中字长的作用最大:

下列代码取自本书代码包中的 naive_classification.py 文件:

import nltk import string import random sw = set(nltk.corpus.stopwords.words('english')) punctuation = set(string.punctuation) def word_features(word): return {'len': len(word)} def isStopword(word): return word in sw or word in punctuation gb = nltk.corpus.gutenberg words = gb.words("shakespeare-caesar.txt") labeled_words = ([(word.lower(), isStopword(word.lower())) for word in words]) random.seed(42) random.shuffle(labeled_words) print labeled_words[:5] featuresets = [(word_features(n), word) for (n, word) in labeled_words] cutoff = int(.9 * len(featuresets)) train_set, test_set = featuresets[:cutoff], featuresets[cutoff:] classifier = nltk.NaiveBayesClassifier.train(train_set) print "'behold' class", classifier.classify(word_features('behold')) print "'the' class", classifier.classify(word_features('the')) print "Accuracy", nltk.classify.accuracy(classifier, test_set) print classifier.show_most_informative_features(5)以上内容选自 《Python数据分析》 ,作者:Ivan Idris,由人民邮电出版社出版,定价:59

【福利推荐】半价电子书:《响应式Web图形设计》折后价:14.50元

更多精彩请关注公众账号:人邮IT书坊

![[HBLOG]公众号](https://www.liuhaihua.cn/img/qrcode_gzh.jpg)