500 行 Python 代码构建一个轻量级爬虫框架

引言

玩 Python 爬虫有段时间了,但是目前还是处于入门级别。 xcrawler 则是利用周末时间构建的一个轻量级的爬虫框架,其中一些设计思想借鉴了著名的爬虫框架 Scrapy 。既然已经有像 Scrapy 这样优秀的爬虫框架,为何还要造轮子呢?嗯,其实最主要的还是想要将学习到 Python 知识综合起来,提高一下自己。

哈哈,其实并没有 500 行代码,因为还有注释和各种空行呢。喜欢爬虫的童鞋也可以参考下,欢迎给出改进建议或者指出错误,谢谢!。

Features

- 简单、易用;

- 易于定制的 Spider;

- 多线程实现并发下载。

待改进

- 更多的测试代码;

- 添加更多的网站爬虫示例;

- 完善爬虫调度,支持 Request 优先级调度。

xcrawler 介绍

项目结构

├── demo (一个示例 Spider)

│ ├── baidu_news.py

│ └── __init__.py

├── README.md (项目文档)

├── setup.py (pip 安装脚本)

├── tests (测试代码,尚未完成)

└── xcrawler (核心代码)

├── core

│ ├── crawler.py (Crawler process,负责管理引擎的配置和启动)

│ ├── engine.py (Crawler engine,负责调度并完成 URL 请求和调用解析方法)

│ ├── __init__.py

├── __init__.py

├── spider

│ ├── __init__.py

│ ├── request.py

│ ├── response.py

│ └── spider.py (Spider 基类,所有的自定义 Spider 需要从此处继承)

└── utils (一些工具函数)

├── __init__.py

└── url.py

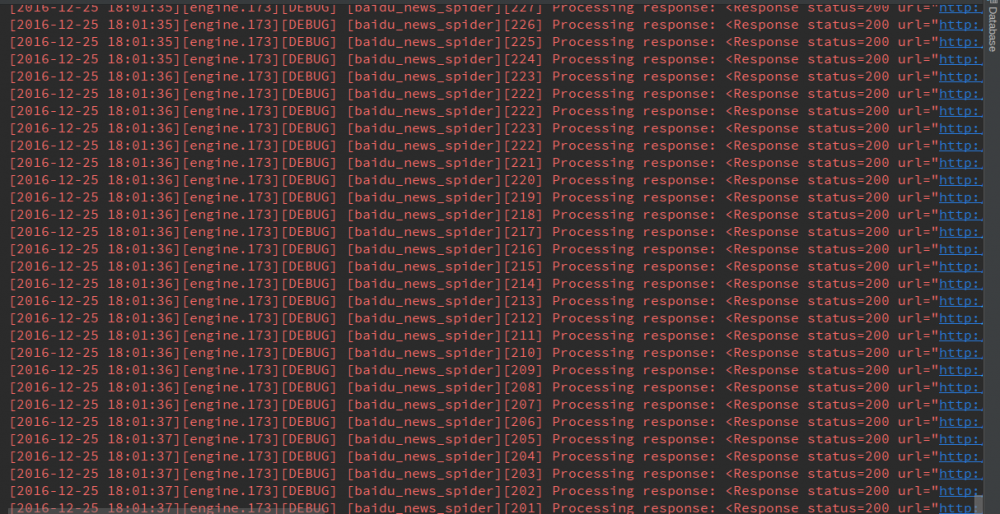

Crawler engine (生产者+消费者模型)

- 引擎启动时会启动一个后台线程池,后台线程池负责下载由调度器提供给它的所有 URL(Request),并将响应(Response)结果存放到队列中;

- 引擎的前台解析线程会不断消费处理队列中的响应(Response),并调用相应 Spider 的解析函数处理这些相应;

- 引擎负责处页面理解析回来的对象,所有的

Request对象都会被放到队列中(递归抓取时)等待处理,所有的字典对象(item)送给 Spider 的process_item方法处理。

配置介绍

- 配置项目

-

download_delay: 每批次之间的下载延迟(单位为秒),默认为 0; -

download_timeout:下载等待延迟,默认为 6 秒; -

retry_on_timeout:即当下载超时后,对应的请求是否应该重试; -

concurrent_requests:并发下载数; -

queue_size:请求队列大小,当队列已满时,会阻塞后续的请求。

-

- 示例配置:

settings = {

'download_delay': 0,

'download_timeout': 6,

'retry_on_timeout': True,

'concurrent_requests': 32,

'queue_size': 512

}

Spider 基类关键方法介绍

-

spider_started:该方法会在引擎启动时被触发调用,你可以通过继承该方法进行一些初始化工作,比如配置 pipeline 输出文件或者数据库连接等等; -

spider_idle:该方法会在引擎处理空闲状态(即没有任何 requests 在队列)时被触发调用,你可以通过继承该方法给引擎添加新的请求等(使用self.crawler.crawl(new_request, spider=self)即可); -

spider_stopped:该方法会在引擎关闭时触发调用,你可以通过继承该方法并在 Spider 结束工作前做一些清理工作,如关闭文件管道、关闭数据库连接等; -

start_requests:该方法会为引擎提该 Spider 的对应种子请求; -

make_requests_from_url:该方法会为你的 URL 创建一个 Request 对象; -

parse:该方法为请求的默认解析函数回调,当然你可以可以在创建 Request 时指定其它的回调函数; -

process_request:每当引擎处理一个 Spider 对应的请求时,该方法会被触发调用,你可以通过继承该方法对 request 做些设置,比如更换随机的 User-Agent,替换 Cookies 或者代理等;当然,你可以将 request 设置为 None 从而忽略该请求; -

proccess_response:每当引擎处理一个 Spider 对应的响应时,该方法会被触发调用; -

process_item:每当引擎处理一个 Spider 对应的 item 时,该方法会被触发调用,你可以通过继承该方法将抓取并解析到的 item 存储到数据库或者本地文件中。

注意

- 你可以在一个 Crawler 进程中装入不同的 Spider class,但需要保证不同的 Spider 的名称也要不同,否则会被引擎拒绝;

- 需要根据情况调整下载延迟和并发数大小;下载延迟尽量不要太大,否则每批请求可能会等待较长时间才会处理完成,从而影响爬虫性能;

- Windows 下的测试还没做,我用的是 Ubuntu,所以如果您有什么问题,欢迎反馈哈!

安装

- 请移步项目主页 xcrawler (https://github.com/chrisleegit/xcrawler) 下载源码;

- 请保证你的安装环境为

Python 3.4+; - 请使用

pip3 setup.py install安装即可。

示例

from xcrawler import CrawlerProcess

from xcrawler.spider import BaseSpider, Request

from lxml.html import fromstring

import json

__version__ = '0.0.1'

__author__ = 'Chris'

class BaiduNewsSpider(BaseSpider):

name = 'baidu_news_spider'

start_urls = ['http://news.baidu.com/']

default_headers = {

'User-Agent': 'Mozilla/5.0 (X11; Linux x86_64) AppleWebKit/537.36 (KHTML, like Gecko) '

'Chrome/50.0.2661.102 Safari/537.36'

}

def spider_started(self):

self.file = open('items.jl', 'w')

def spider_stopped(self):

self.file.close()

def spider_idle(self):

# 引擎空闲时,你也可以从数据库中提取新的 URL 进来

print('I am in idle mode')

# self.crawler.crawl(new_request, spider=self)

def make_requests_from_url(self, url):

return Request(url, headers=self.default_headers)

def parse(self, response):

root = fromstring(response.content, base_url=response.base_url)

for element in root.xpath('//a[@target="_blank"]'):

title = self._extract_first(element, 'text()')

link = self._extract_first(element, '@href').strip()

if title:

if link.startswith('http://') or link.startswith('https://'):

yield {'title': title, 'link': link}

yield Request(link, headers=self.default_headers, callback=self.parse_news,

meta={'title': title})

def parse_news(self, response):

pass

def process_item(self, item):

print(item)

print(json.dumps(item, ensure_ascii=False), file=self.file)

@staticmethod

def _extract_first(element, exp, default=''):

r = element.xpath(exp)

if len(r):

return r[0]

return default

def main():

settings = {

'download_delay': 1,

'download_timeout': 6,

'retry_on_timeout': True,

'concurrent_requests': 16,

'queue_size': 512

}

crawler = CrawlerProcess(settings, 'DEBUG')

crawler.crawl(BaiduNewsSpider)

crawler.start()

if __name__ == '__main__':

main()

版权声明

- 本文由 Christopher L 发表,采用 知识共享署名-非商业性使用-相同方式共享 4.0 国际许可协议 进行许可。请确保你已了解许可协议,并在 转载 时声明。

- 本文固定链接: http://blog.chriscabin.com/?p=1512 。

正文到此结束

热门推荐

相关文章

Loading...

![[HBLOG]公众号](https://www.liuhaihua.cn/img/qrcode_gzh.jpg)